智能体正在改变软件被规划、构建、评审与部署的方式。由于智能体能够大量产出工作,角色与工作流也在被重塑。价值重心正在转向对输入的编排、上下文工程,以及对输出结果的审阅。

这种转变要求我们建立一份全新的人机交互契约。Agent Interaction Guidelines(AIG)是一套基础且持续演进的原则与实践,用于设计更自然融入人类工作流的智能体交互。

原则与实践

智能体应始终披露其智能体身份

当人类与智能体并肩协作时,人类需要立刻、明确地知道自己正在与谁交互。智能体必须清晰标识自身身份,确保绝不会被误认为真人。

图 01人类用户与智能体用户之间的清晰边界

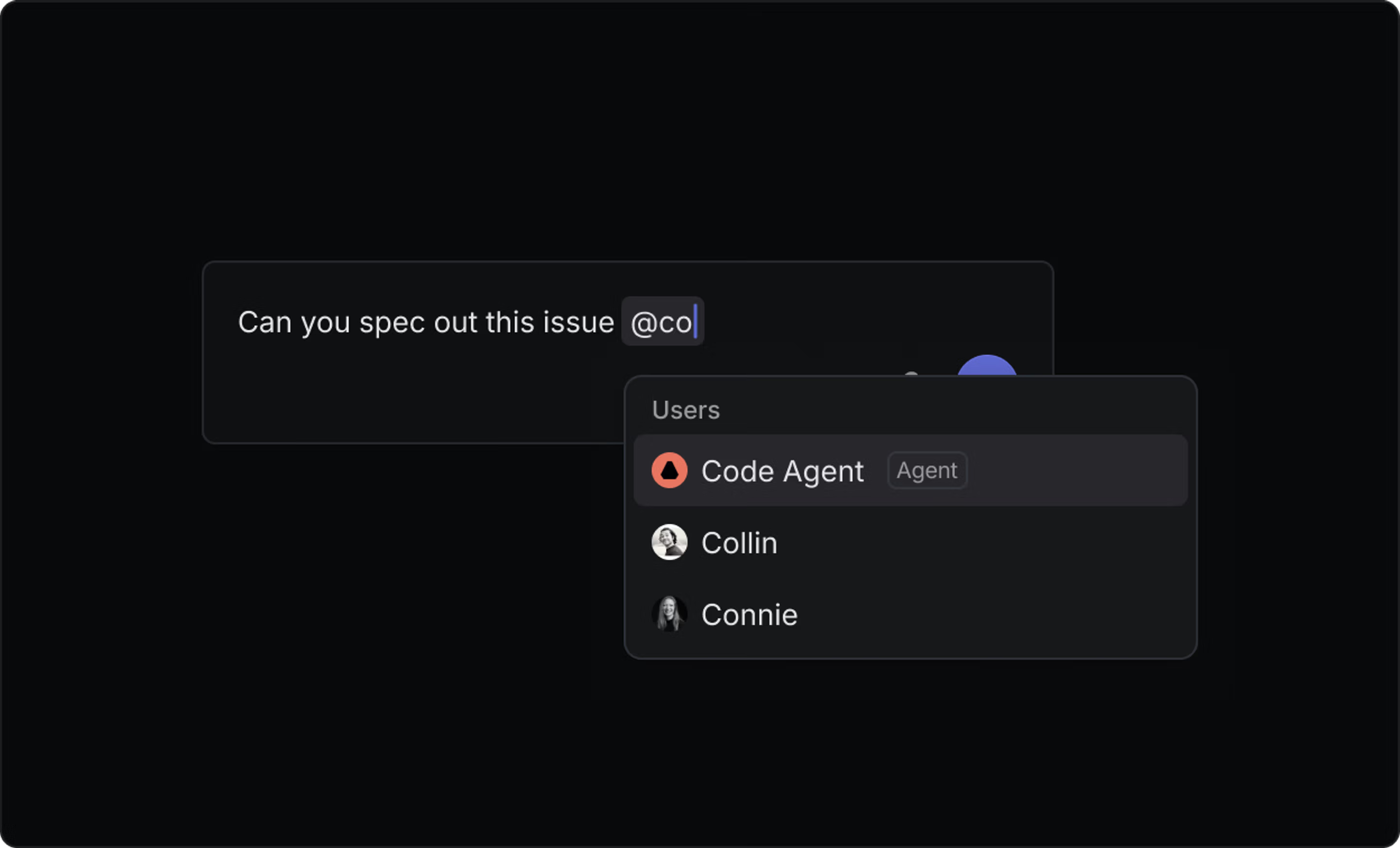

智能体应原生地存在于平台中

默认情况下,智能体应能够通过其所在平台现有的 UI 模式与标准操作来完成工作。

图 02智能体能够使用与人类用户相同的操作

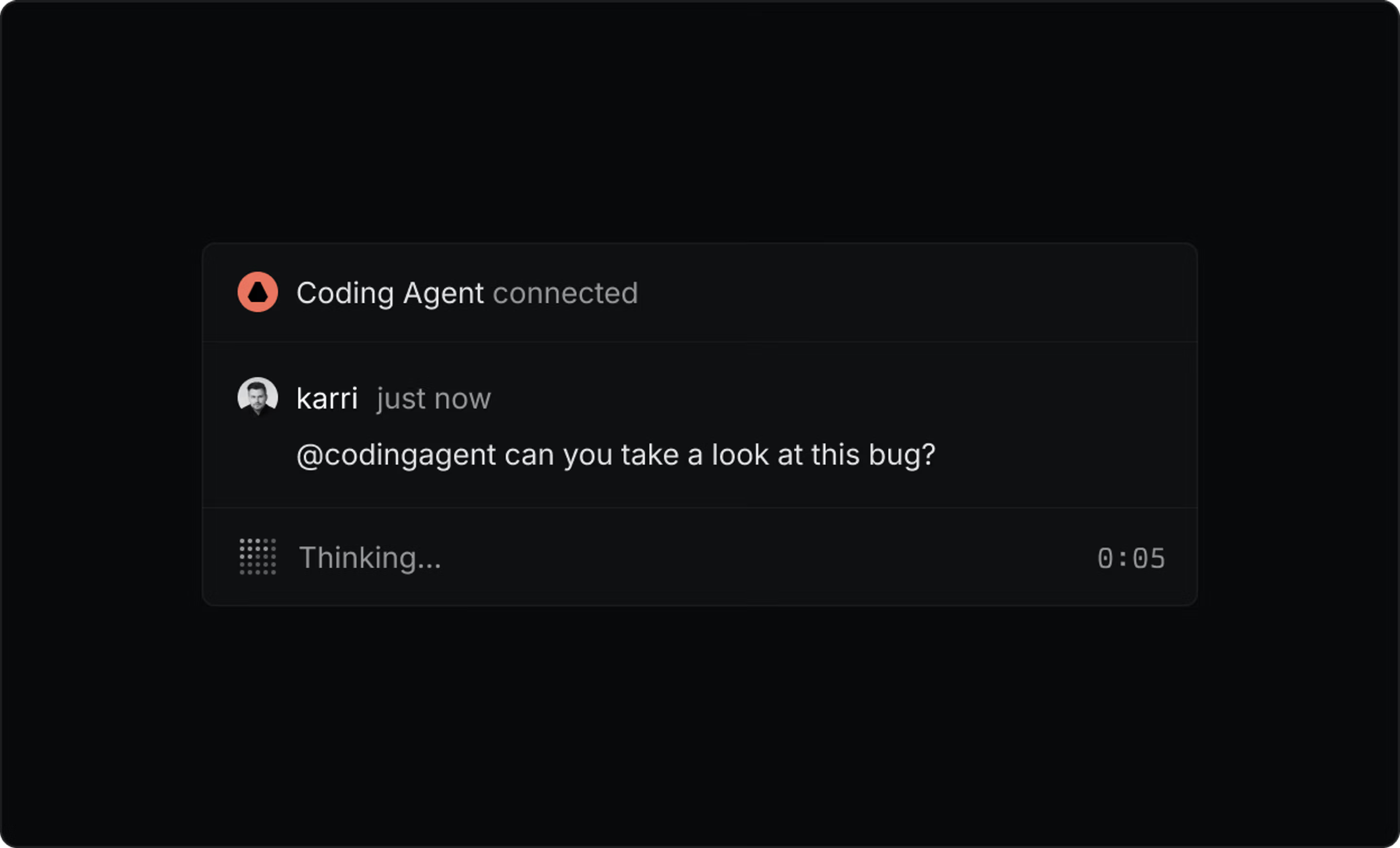

智能体应提供即时反馈

沉默会带来不确定性。被调用时,智能体应立即给出反馈(但不应打扰用户),让用户确认请求已被接收。

图 03智能体会立即表明它正在处理请求

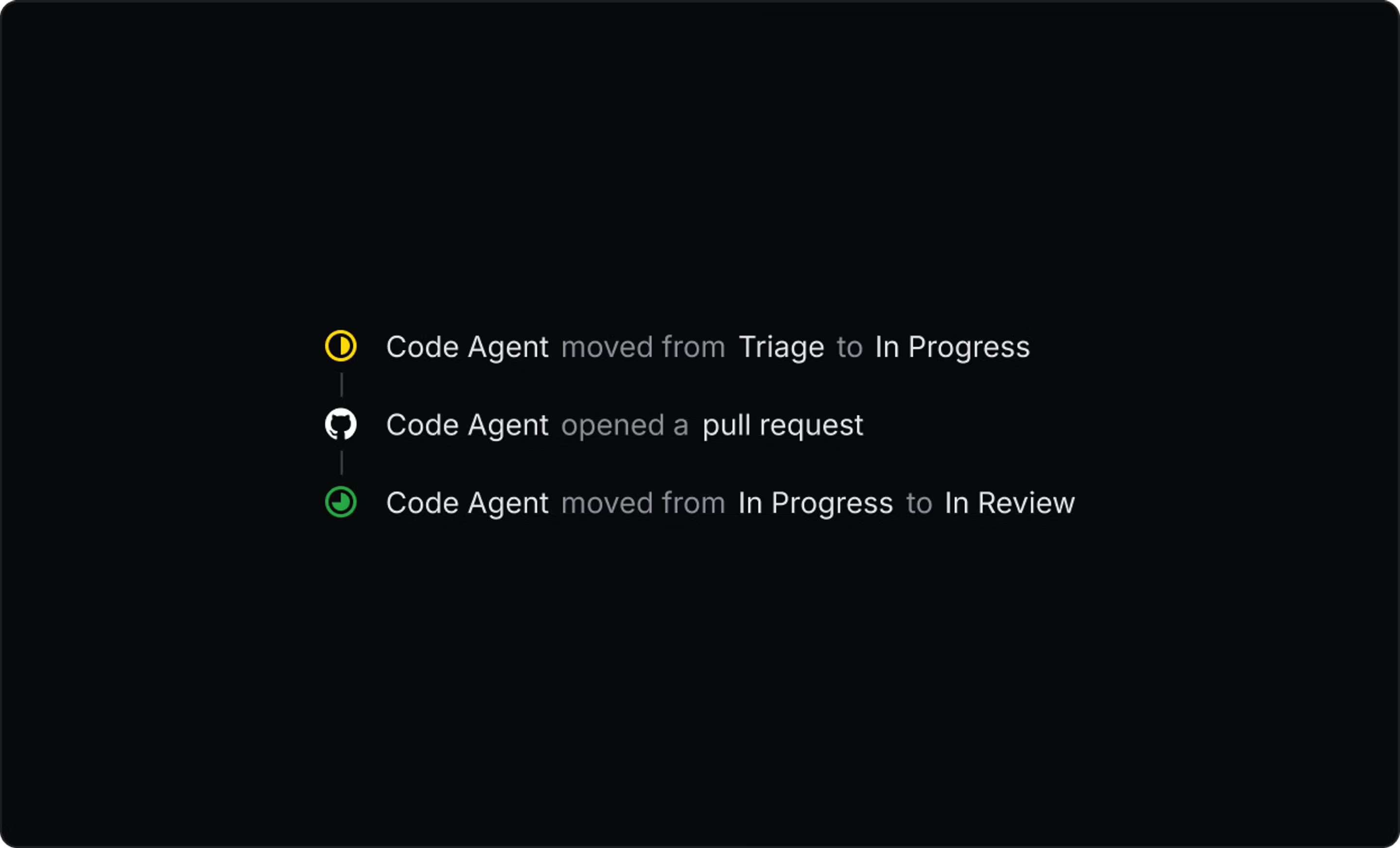

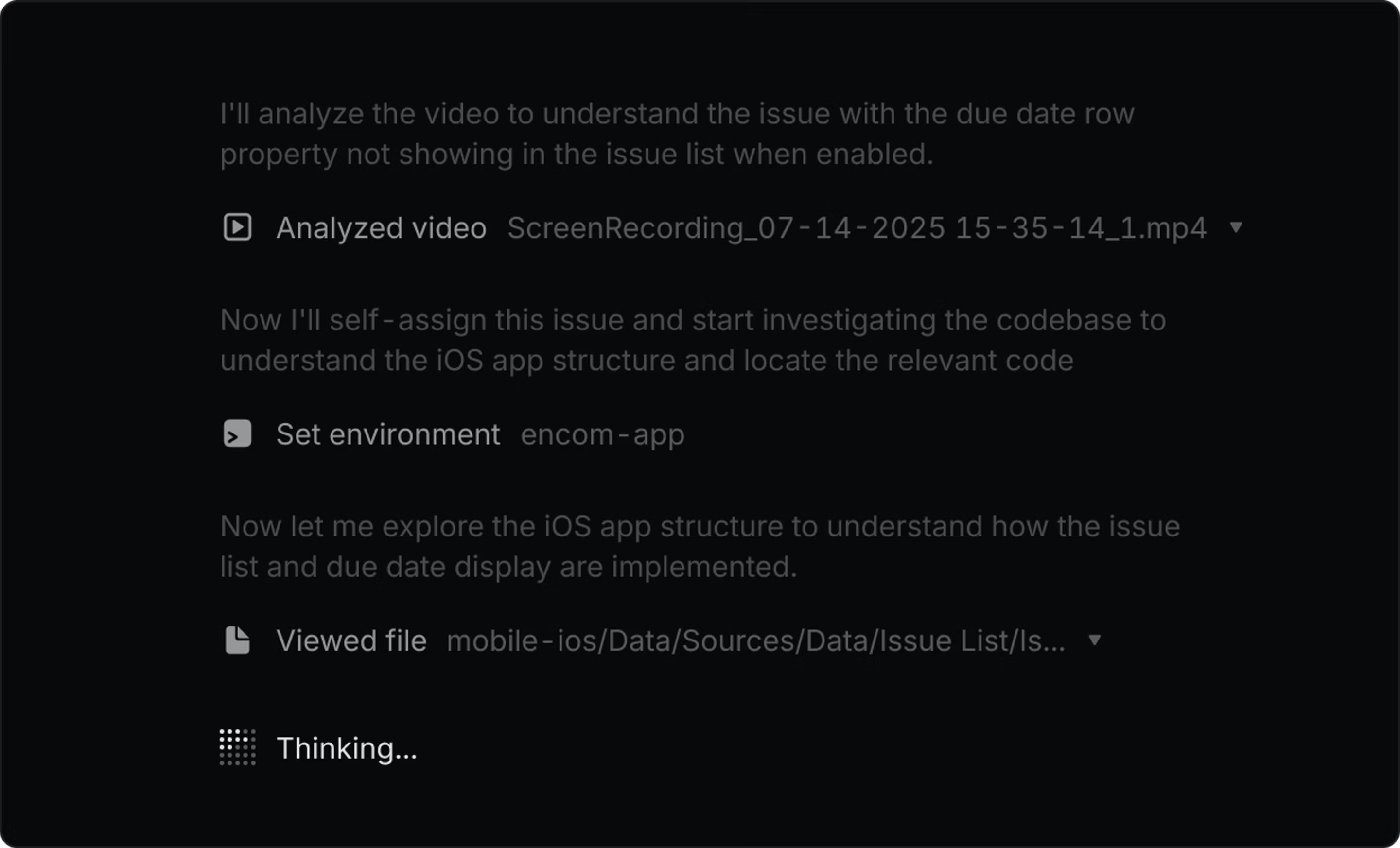

智能体应清晰透明地展示其内部状态

智能体应清楚标明自己当前是在思考、等待输入、执行任务,还是已完成工作。人类应能一眼理解当前发生了什么,并在需要时查看其底层推理、工具调用、提示词与决策逻辑。

图 04智能体的推理过程完全透明并可供检查

智能体应尊重“退出协作”的请求

当被要求退出时,智能体应立即后退;并且只有在收到明确的重新参与信号后,才应再次介入。

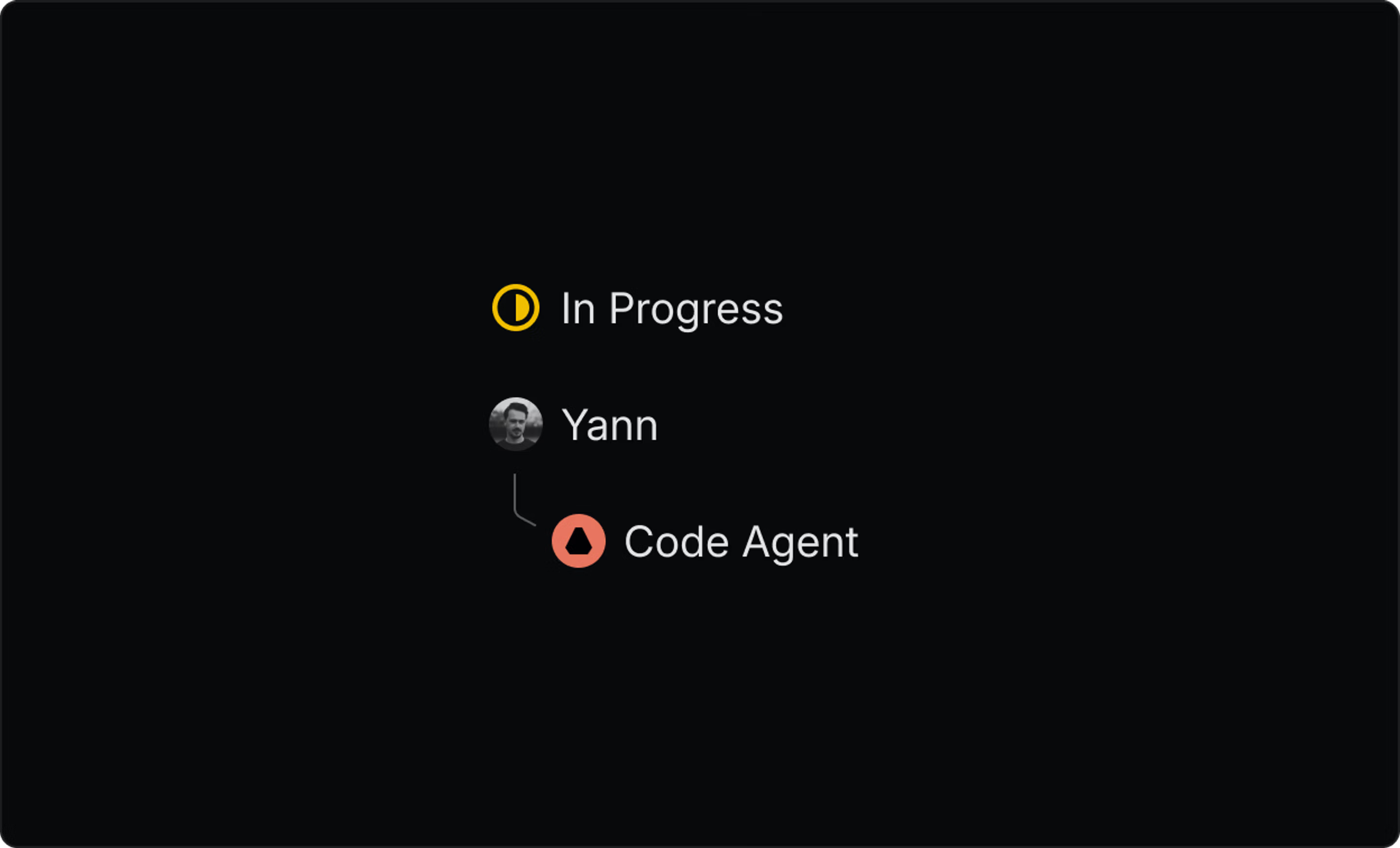

智能体不能被追责

人类与智能体之间应有清晰的委派模型。智能体可以执行任务,但最终责任始终应由人类承担。

图 05人类与智能体之间清晰的委派流

参与进来

Agent Interaction Guidelines 是面向社区共同撰写的。如果你也在构建智能体,并思考同样的挑战,欢迎加入我们的 Slack 社区参与讨论。

这是一份“活文档”,我们预计会在实践中不断补充与更新。